Что изменилось? Как изменения повлияют на ранжирование сайтов в поисковой выдаче?

Разберемся со всеми вопросами далее.

Что произошло?

Google обновил версию поискового краулера Googlebot.

Работа над улучшением Googlebot велась более года.

По сути обновился движок рендеринга, который использует краулер Googlebot.

Теперь для краулинга используется последняя версия движка рендеринга — Chromium 74.

Ранее краулер использовал аж 41-ую версию.

В дальнейшем версия краулера будет регулярно обновляться в соответствии с обновлениями Chromium.

Такой подход призваны обеспечить поддержку всех новых возможностей, которые появляются в обновленных версиях Chromium.

Например, в Chromium 75 появится новая функциональность, которая позволит использовать на сайте ленивую загрузку изображений и iframe через применение атрибута loading.

Обновленный краулер Google отличается от предыдущего тем, что поддерживает более 1 000 новшеств.

Иными словами, теперь для поисковых алгоритмов множество страниц будет выглядеть несколько иначе, нежели ранее.

Такие изменения влияют на ранжирование сайтов.

Наиболее значимыми являются изменения, касающееся поддержки выполнения JavaScript. Такие изменения введены, так как на большинстве сайтов скрипты используются все больше.

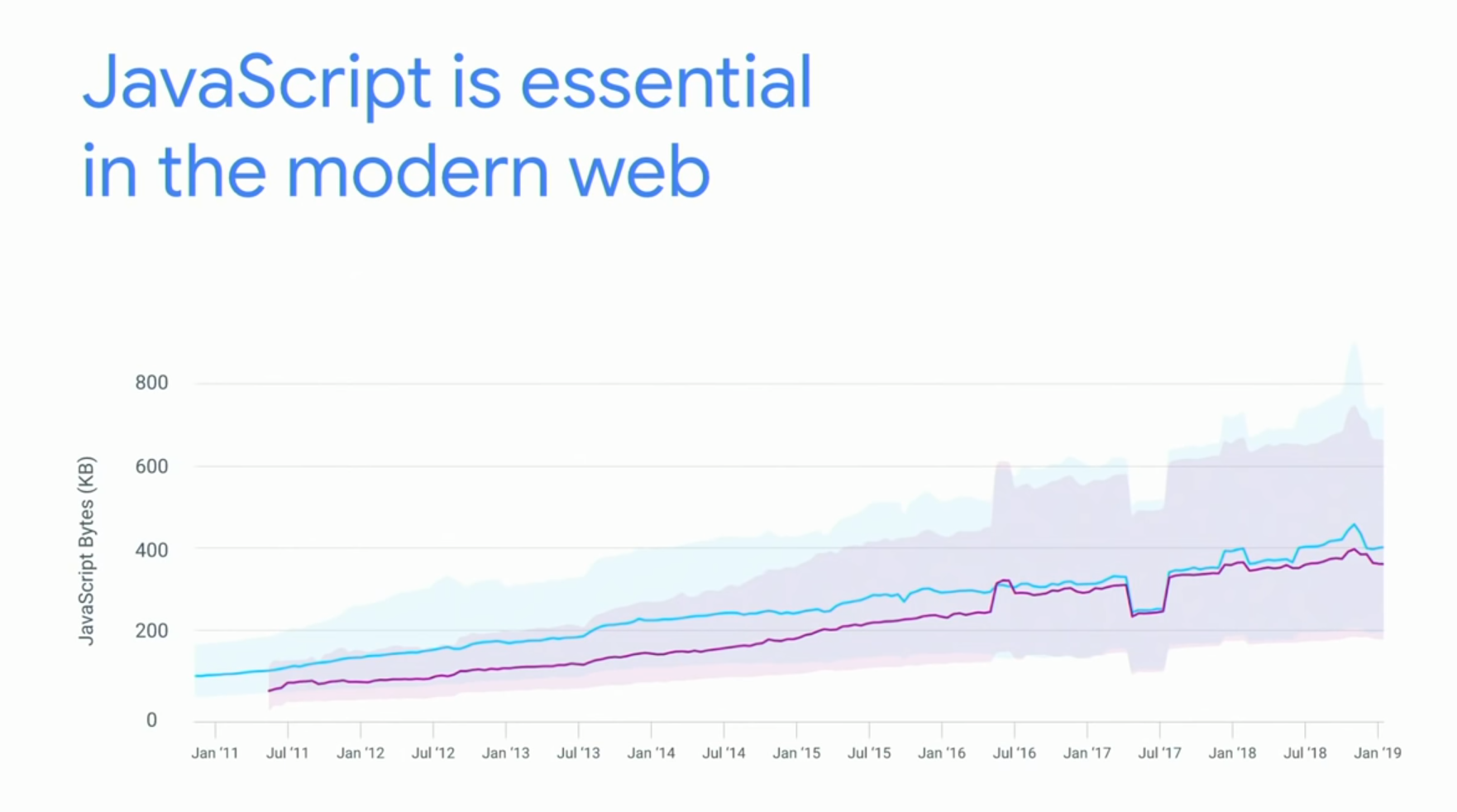

Данные по использованию JavaScript на сайтах:

Что в результате?

Итак, новая версия Googlebot поддерживает более 1 000 новшеств.

Рассмотрим наиболее значимые изменения.

1 — Поддержка веб-компонентов

В обновленной версии Googlebot появилась поддержка веб-компонентов.

Ссылка на документацию — Web Components v1 APIs.

Ранее использование веб-компонентов на сайте было недопустимым с точки зрения поисковой оптимизации. Теперь Googlebot умеет обрабатывать такие модули.

На практике веб-компоненты используются для создания элементов интерфейса, которые на сайте переиспользуются множество раз.

Такими элементами могут быть шаблоны для навигации, формы для ввода и галереи. Во всех таких элементах используется JavaScript API.

2 — Поддержка IntersectionObserver for lazy-loading

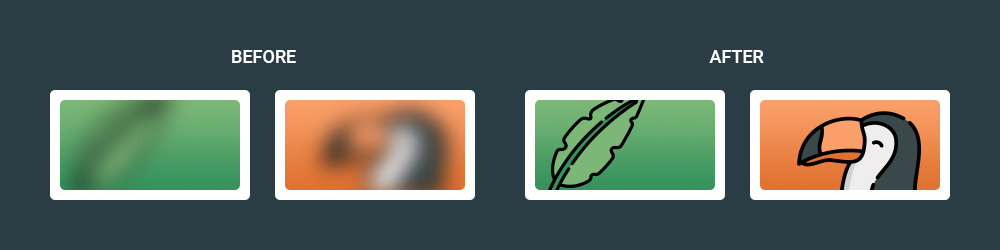

В обновленной версии Googlebot появилась поддержка IntersectionObserver for lazy-loading.

Ссылка на документацию — Lazy Loading Images and Video.

На практике IntersectionObserver for lazy-loading используется для реализации ленивой загрузки изображений, что позволяет повысить скорость загрузки сайта.

Итак, теперь технология IntersectionObserver for lazy-loading поддерживается Googlebot, а значит поисковая система найдет на странице все оригинальные файлы изображений, которые подгружаются по требованию.

Рекомендованный материал в блоге MegaIndex по теме поисковой оптимизации изображений по ссылке далее — SEO оптимизация изображений — Как получать трафик за счет SEO оптимизации изображений.

3 — Поддержка ES6

В Googlebot появилась поддержка ECMAScript 6, а соответственно новой функциональности JavaScript.

Теперь есть возможность индексировать single page application, так называемые SPA сайты.

Рекомендованный материал в блоге MegaIndex по теме поисковой оптимизации сайтов и JavaScript по ссылке далее — JavaScript и SEO.

Что не изменилось?

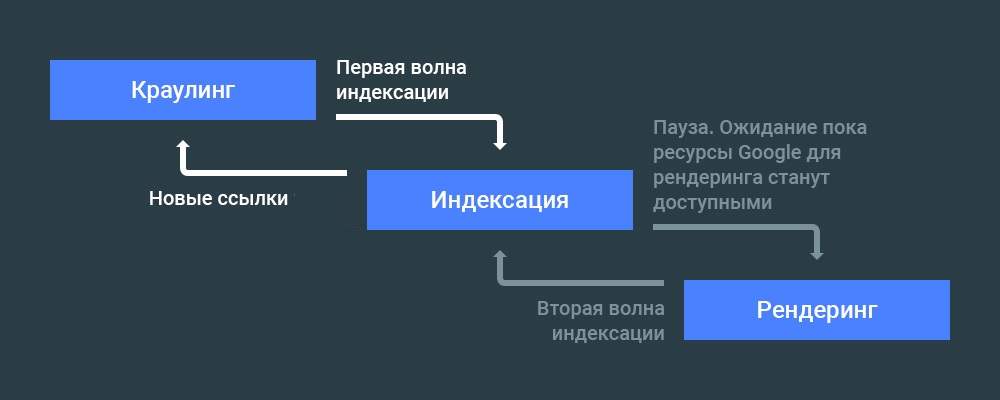

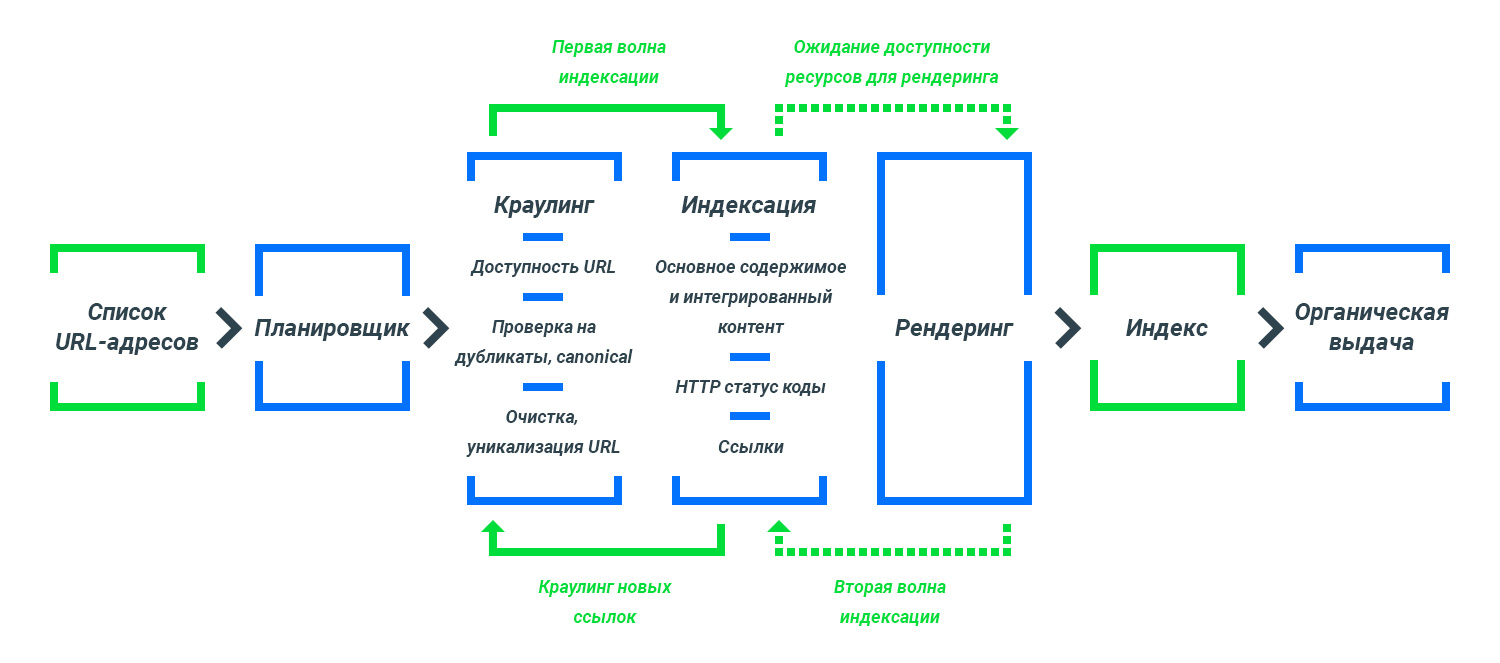

Поисковая система Google по-прежнему обрабатывает страницы сайтов в две волны.

Значит сложность и объем JavaScirpt скриптов, используемых на странице, влияет на скорость индексации.

Рендеринг страниц на серверах Google напрямую зависит от JavaScript.

Весь процесс выглядит так:

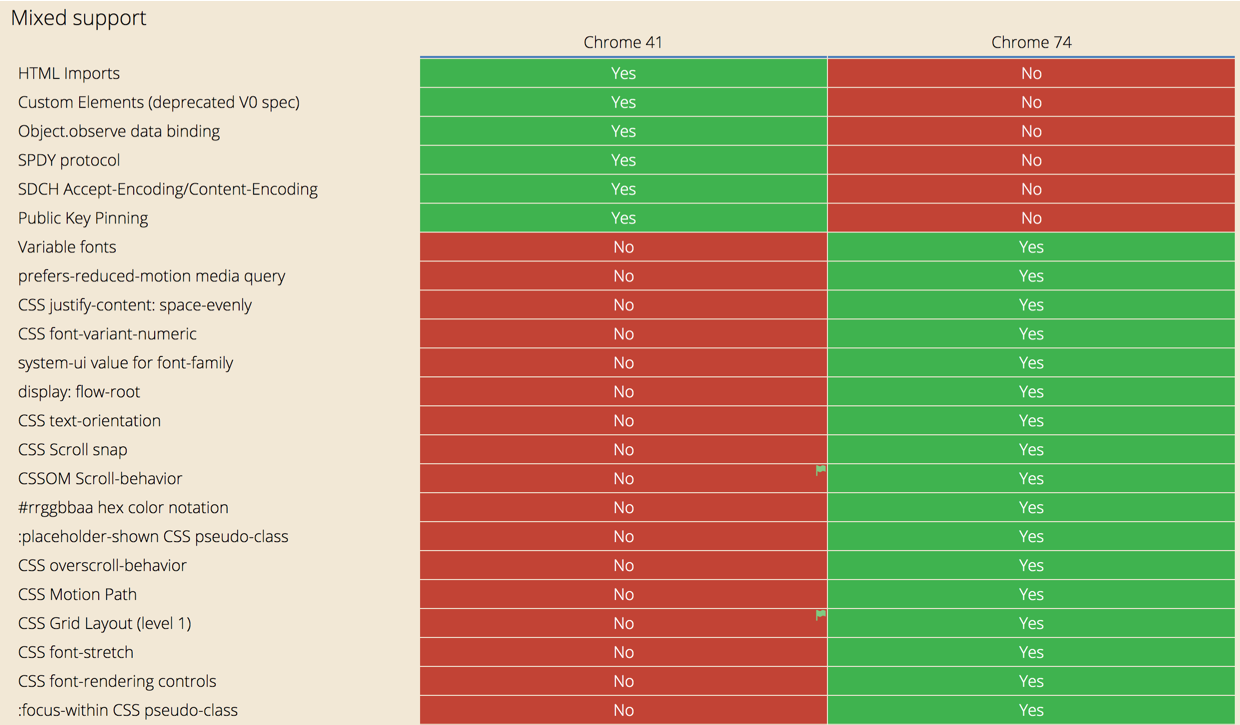

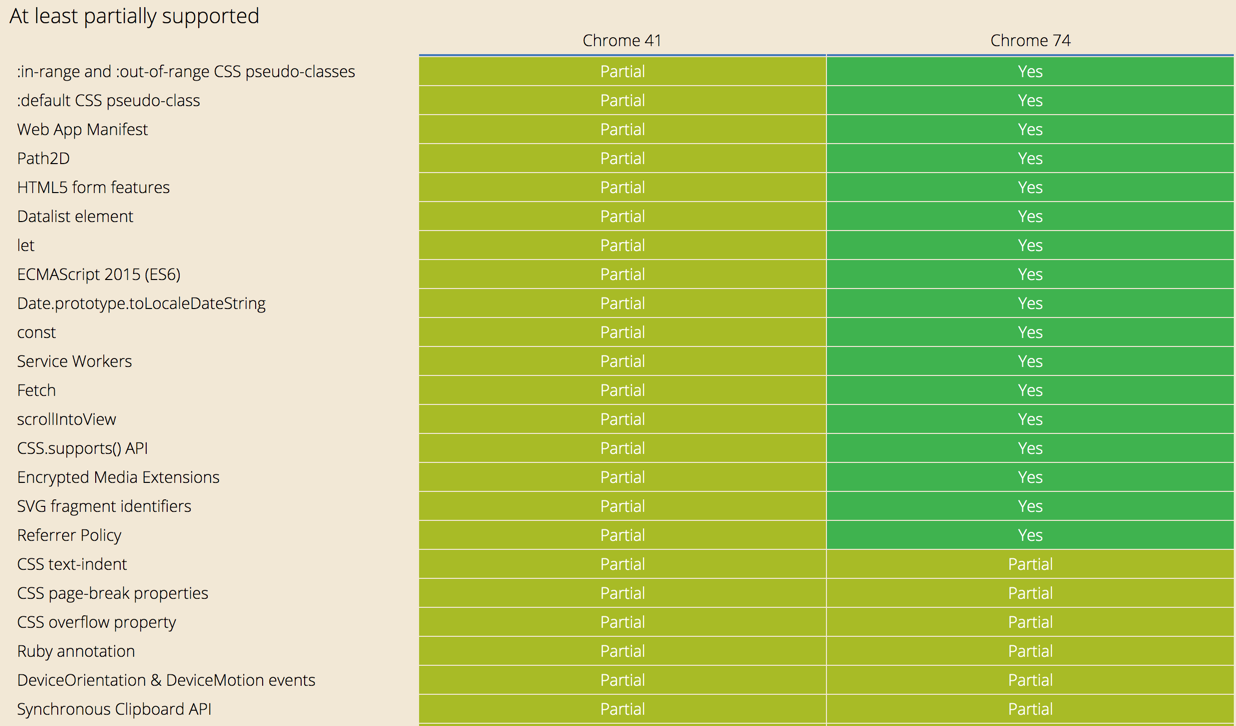

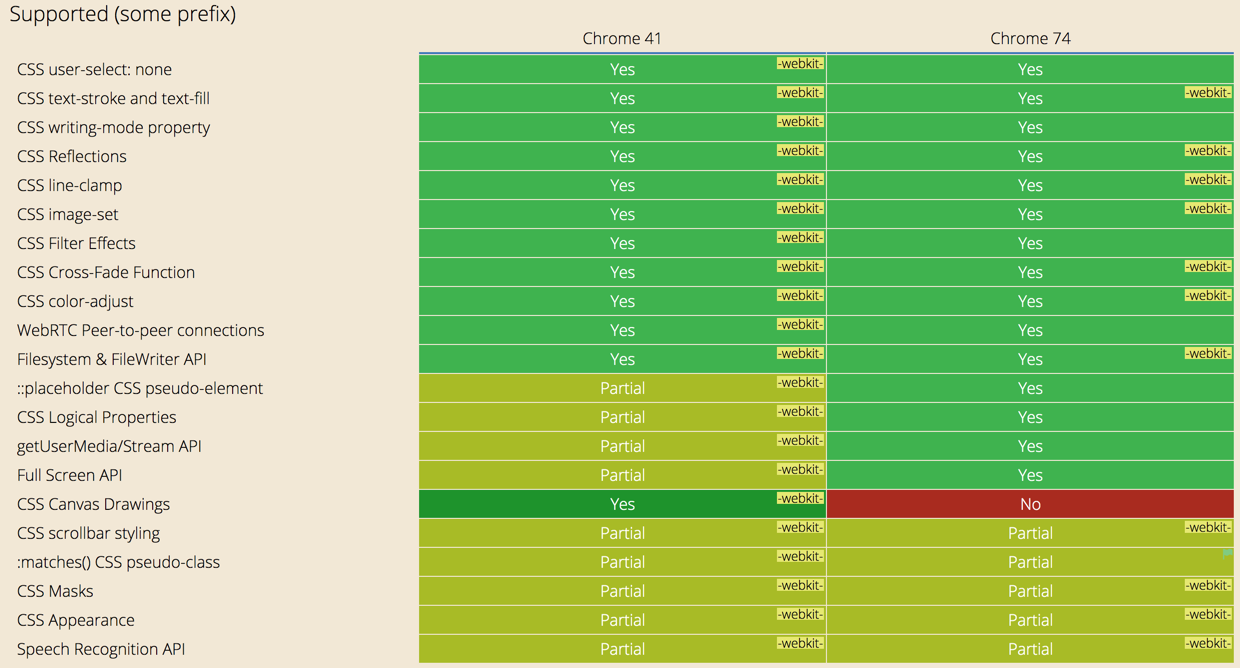

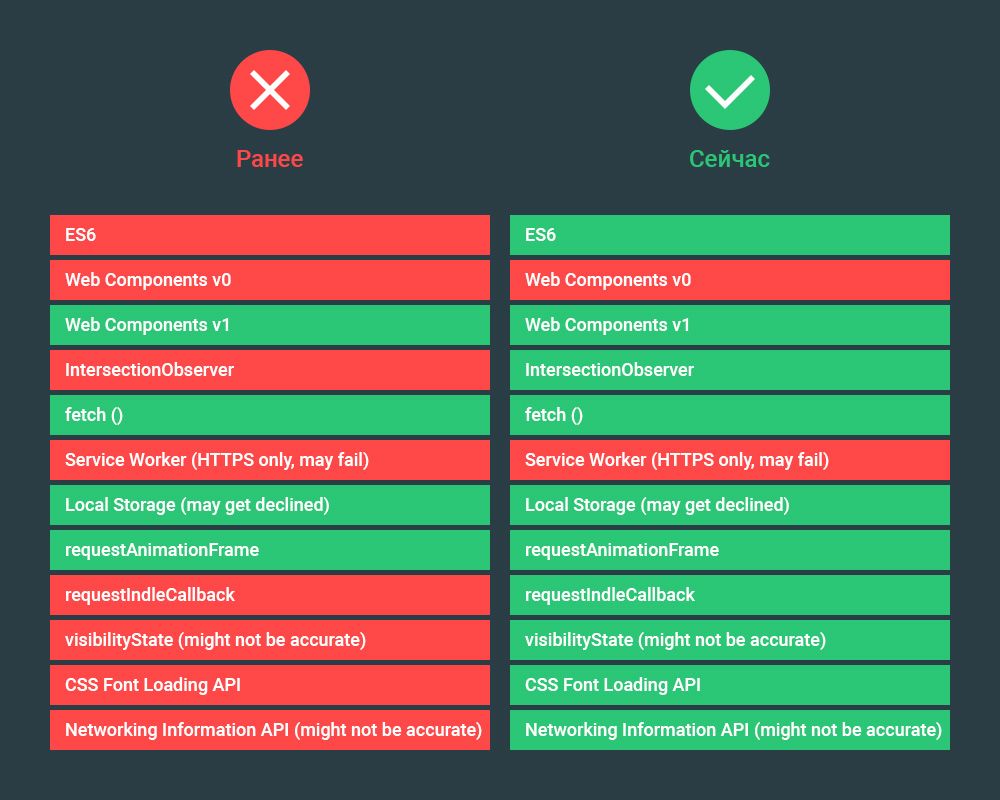

Сравнительная таблица изменений в Googlebot

Далее сравнительная таблица изменений в краулере Google.

Вопросы и ответы

Что такое Googlebot?

Googlebot — это поисковый робот, который сканирует интернет, и включает страницы сайтов в индекс поисковой системы Google.

Что такое SPA?

SPA — это одностраничное приложение или сайт, использующий один единственный HTML-документ как оболочку для всех страниц сайта и организующий взаимодействие с пользователем через динамически подгружаемые HTML, CSS, JavaScript.

Подобная подгрузка происходит обычно посредством AJAX.

Учитывается ли обновление в сервисе тестирования Google Mobile Friendly Test?

Пока не все сервисы Google перешли на использование более совершенной версии Googlebot.

В перспективе Google станет учитывать изменения связанные с Googlebot во всех сервисах, и на всех своих сайтах.

На данном этапе процесс находится на стадии тестирования, перед внедрением.

Почему на мой сайт заходит Googlebot Chrome 41?

Название Googlebot в User Agent пока не изменилось. Поэтому название версии является не достоверным.

На самом деле используется обновленный Googlebot.

Значение в записи User Agent будет обновлено позже.

Изменится ли краулинговый бюджет?

В следствии обновления возросла нагрузка на сервис Google, который используется для рендеринга страниц, так как поддерживается больше новшеств.

Но краулинговый бюджет для сайтов изменяться не будет.

Значение crawl бюджета не зависит от сложности и объема JavaScript, который используется на странице сайта.

Есть ли разъяснения от Google?

Да. Есть презентация обновленной версии Googlebot с конференции Google IO.

Рекомендованный материал в блоге MegaIndex на тему изменения в поисковой выдаче Google по ссылке далее — Стало известно как изменится формат поисковой выдачи в Google в 2020 году.

Выводы

Google обновил поисковый краулер. В результате улучшается рендеринг страниц, на которых используется JavaScript. Но Googlebot может выполнять не все скрипты.

Для примера можно сравнить функциональные возможности версии движка Chrome 41 и Chrome 74 — Сравнение функциональных возможностей.

Выполнения JavaScript не следует путать с выполнением пользовательских действий. Google не стал выполнять такие сценарии как клики, скроллинг, и взаимодействие с формами.

Итак, новшества позволяют Google индексировать больше контента с страницы.

Значит по результатам переиндексации изменятся и позиции множества страниц.

Что делать:

- После переиндексации, провести анализ страниц сайта в кеше Google;

- Вместо сторонних решений для ленивой загрузки использовать решение, которые поддерживается поисковым краулером — IntersectionObserver for lazy-loading;

- Если на сервере используется server-side rendering для того, чтобы поисковому краулеру передавать сгенерированные страницы, то использование такой функциональности можно пересмотреть. В результате сэкономить ресурсы на содержание проекта;

- Если на сайте используется JavaScript, то поставить задачу на рефакторинг кода.

Весь процесс попадания страниц сайтов в поисковую выдачу состоит из множества этапов и выглядит так:

Исходя из последовательности шагов, оптимизация рендеринга страниц входит в комплекс мер по поисковой оптимизации сайта.

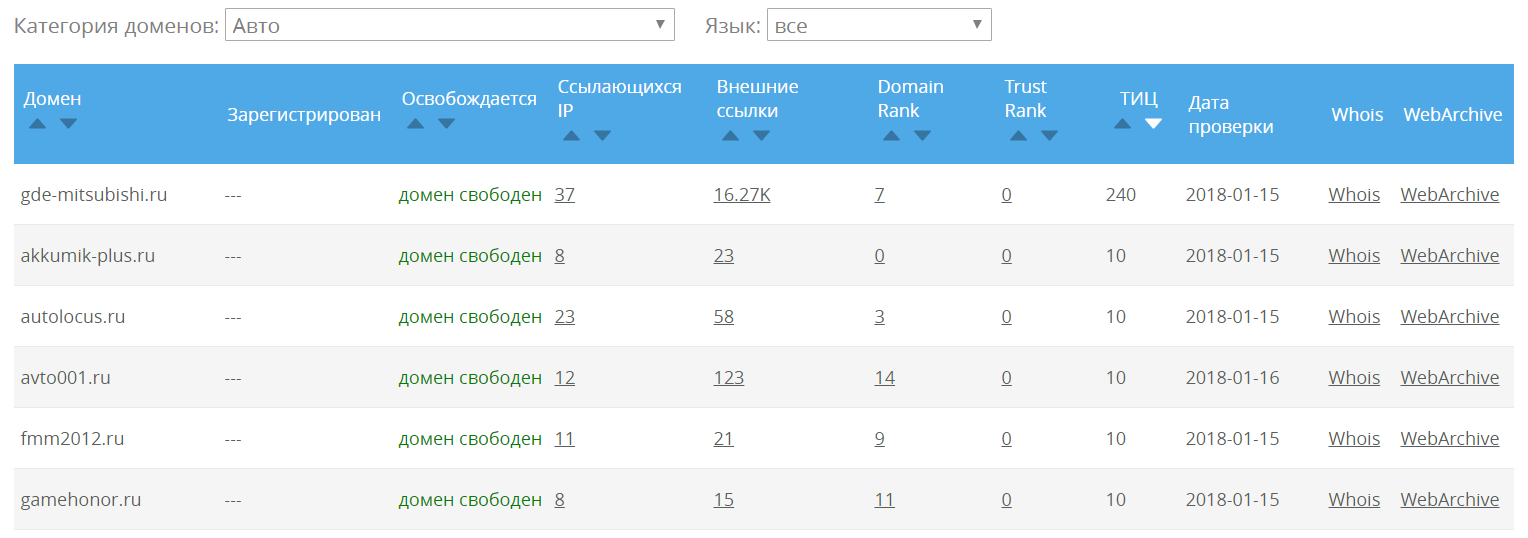

Если для продвижения сайта использовать частные сети сайтов, то проверять потенциальную эффективность доменных имен можно быстрее, если использовать 301 редирект.

Найти освободившиеся доменные имена можно посредством специальных бесплатных или платных сервисов. Например, можно использовать MegaIndex.

Ссылка на сервис — Удаленные домены.

Сервис бесплатный.

Рекомендованный материал в блоге MegaIndex по ссылке далее — Что лучше: ссылка или 301 редирект?.

На практике разработка сайта с учетом требований поисковой оптимизации упрощается еще по той причине, что Microsoft заявили о переводе стандартного браузера Windows Edge на Chromium.

В результате большинство популярных интернет браузеров будут поддерживать тот же набор функциональных возможностей, что и Googlebot.

Chromium уже используется в таких браузерах как:

- Google Chrome;

- Opera;

- Яндекс Браузер.

Итак, обновленный поисковой краулер Googlebot поддерживает ряд новых технологий. Наиболее значимые изменения в следующем:

Что дальше?

В сети появился анонс движка Chrome 76, в котором будет поддерживаться ленивая загрузка для iframe и изображений. Сейчас для решения задачи требуется применять IntersectionObserver for lazy-loading. С обновлением реализация ленивой загрузки изображений на практике упростится.

Что это значит?

Теперь при правильной разметке поисковые краулеры смогут индексировать изображения, подгружаемые по требованию.

Какая от этого польза для поискового оптимизатора?

Преимущества следующие:

- Увеличение скорости загрузки страниц сайта. Влияет на конверсии. Влияет на ранжирование;

- Быстрое и простое внедрение на сайте;

- Экономия в плане нагрузки на сервер.

Если тема интересна, напишите в комментариях. Можно создать отдельный пост с примерами по реализации на практике.

Остались ли у вас вопросы, замечания или комментарии по теме обновления краулера Google?

Обсуждение

В плане переиндексации - тут отдельный юмор.

1. Ставим 404. Страница в индексе/ранжируется

2. Ставим 404, вручную удаляем инструментом. Страница в индексе/ранжируется

3. Ставим 410, вручную удаляем. Страница в индексе/ранжируется

4. Закрываем в robots, ставим 410, закрываем уже тегами, вручную удаляем. Страница в индексе/ранжируется.

И так уже более года.

Про выдачу я уже давно молчу, а про коммерческую - даже и не вспоминал.

Вероятно, гугл допустил ошибку, когда нанял такое количество индусов в отдел качества поиска.

Прямо вижу как по Московской и другой RU выдаче начались изменения. Согласитесь, но гугл сдает. И причины такой стратегии лично мне непонятны. Выше уже написал, что с десяток страниц, несмотря на все усилия, гугл выбрасывать из индекса не желает. Яндекс выкинул их спустя пару дней. О каком качестве индексирования, и уж тем более - ранжирования, может идти речь?

Новшества позволяют Google индексировать больше контента с страниц>

То есть, до этого он индексировал лишь какую-то часть контента? Полстраницы? Без картинок? Только if-modified заголовки? Только то, что удалось сжать и присвоить значение на этапе первой загрузки? Поясните пожалуйста, а то я, видимо, какой-то другой информационный поиск все это время изучал. И опять же - а ранжирование здесь причем?

Краулер всего лишь сканирует - в его задачи не входит что-то там ранжировать, Алгоритм уже обсчитывает док по своим параметрам и принимает решение о его "качестве". Это как если бы сказали, что решение о том, поднимать вам зарплату или нет - принимает не ваш директор, а кассир.

И есть еще ряд прямых зависимостей, сказывающихся на ранжировании страниц>

Это каких же? На моей памяти - всего две: гугл мой бизнес, тонна безанкорных ссылок, либо пару сквозняков с сайта, где 2-5 тыс. страниц.

Гляньте мебельную тематику или автозапчасти по ахрефс - вы будете удивлены, насколько все банально.

Вот не думал, что скажу такое, но Яндекс по качеству поиска, особенно - коммерция - гораздо выше гугла. Черт его знает, почему так, но в плане индексации/ранжирования/качества комм. серпа Яндекс вполне себе так заткнул гугл за пояс очень далеко.